-

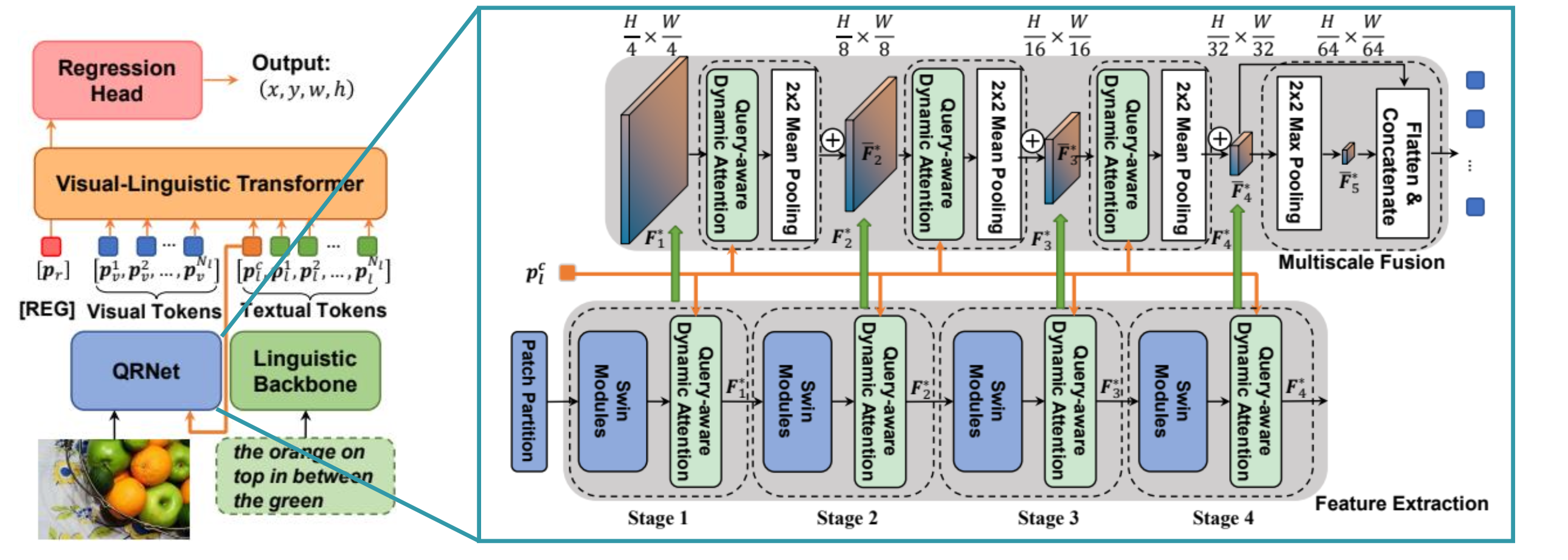

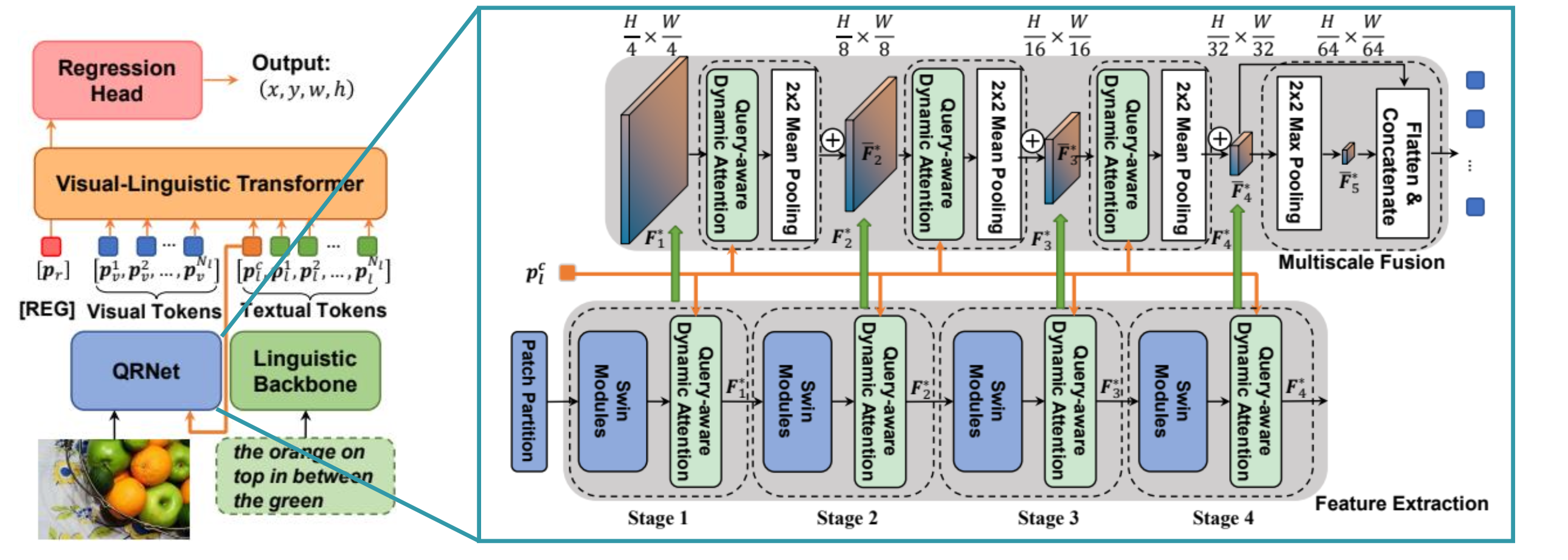

通常のV&Lモデルでは, 画像のバックボーンネットワークは言語特徴量を使用しない

- そのようなモデルでは, 「画像にりんごはいくつあるか?」などといったVQAタスクすら解けない(可能性が高い)

-

そこで, SwinTransformerを拡張し, 各ステージで言語特徴量をspatial / channel方向にmixしながら推論していくモデルを提案

-

タスクは物体検出なので, regトークンを付けて回帰問題を解く

-

データセットにReferItGameとFlickr30Kを使用

通常のV&Lモデルでは, 画像のバックボーンネットワークは言語特徴量を使用しない

そこで, SwinTransformerを拡張し, 各ステージで言語特徴量をspatial / channel方向にmixしながら推論していくモデルを提案

タスクは物体検出なので, regトークンを付けて回帰問題を解く

データセットにReferItGameとFlickr30Kを使用