- 概要

-

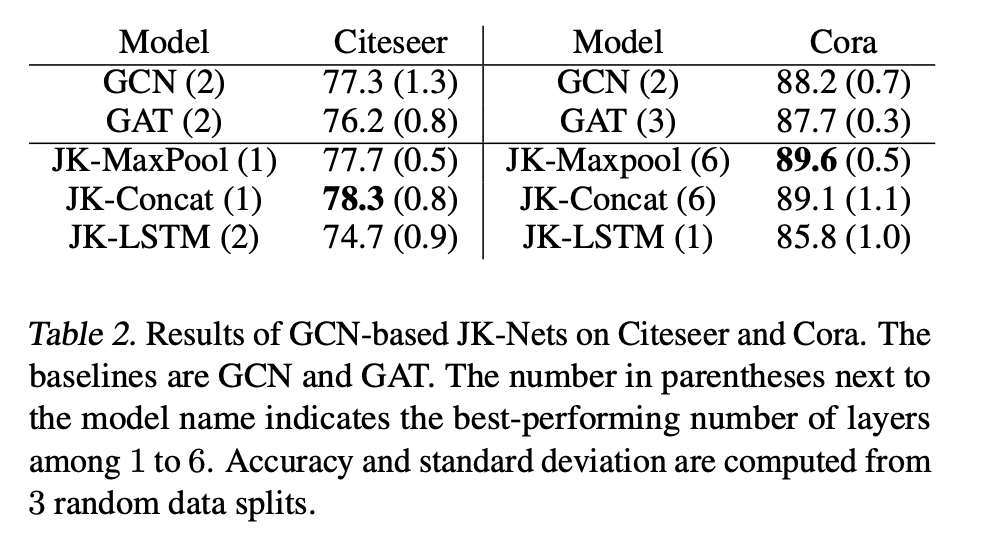

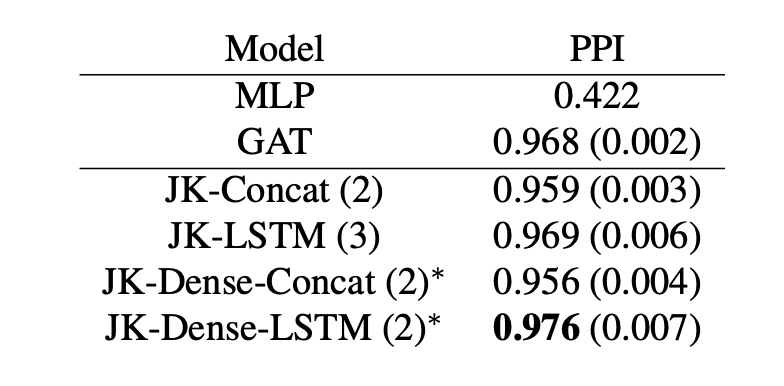

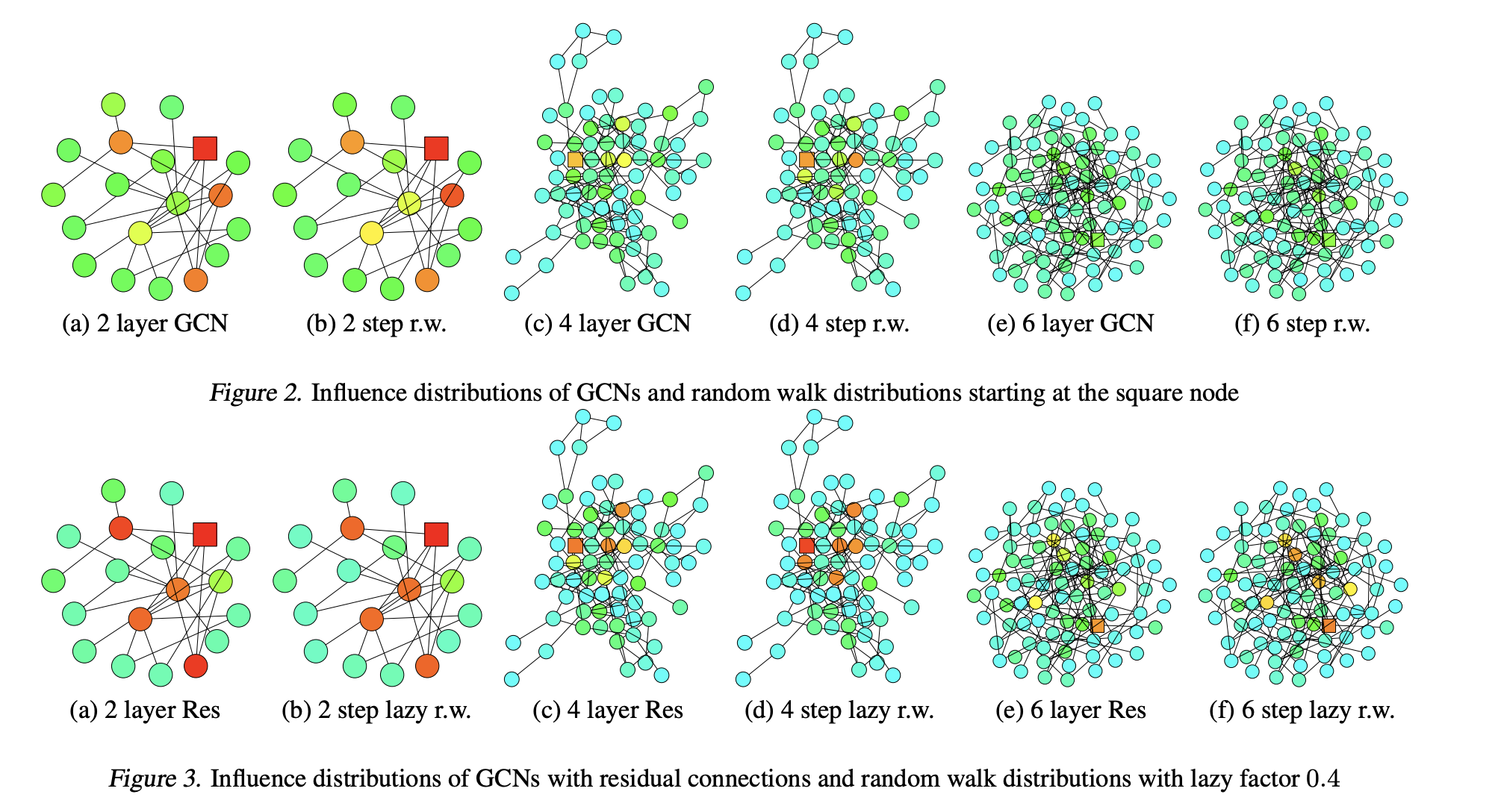

隣接ノードからのaggregationだけでは, k層のGCNはただのrandom-walkと変わらない

-

r.w = random-walk

-

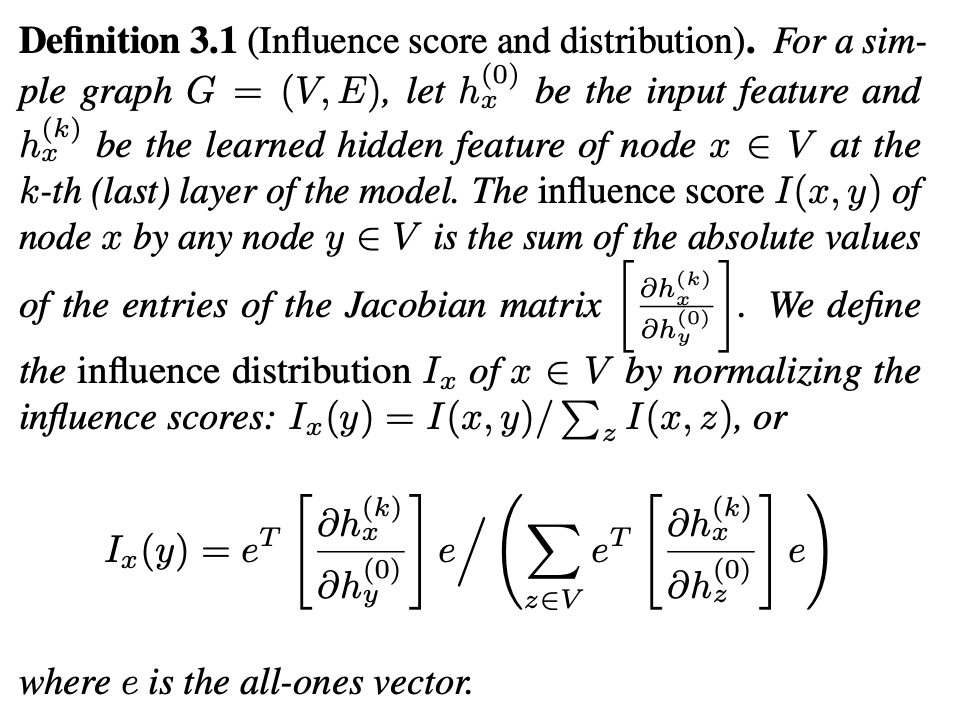

濃い色のノードはInfluence Probabilityの高いもの

-

各ノードの影響範囲が大きくてもダメだし, 小さくてもダメ

- なので, 各層の出力をすべて使用し, モデルに適切な影響半径を決めさせるJumping Knowledge Networksを提案

$${\boldsymbol{h}_i = \mathrm{AGGREGATE}(\boldsymbol{h}_i^0,…,\boldsymbol{h}_i^L)}$$

- なので, 各層の出力をすべて使用し, モデルに適切な影響半径を決めさせるJumping Knowledge Networksを提案

-

AGGREGATEには, concat / Max-pooling / LSTM_attn が提案されている

-